HI-TECH

Anthropic uvodi verifikaciju identiteta za pojedine Claude korisnike

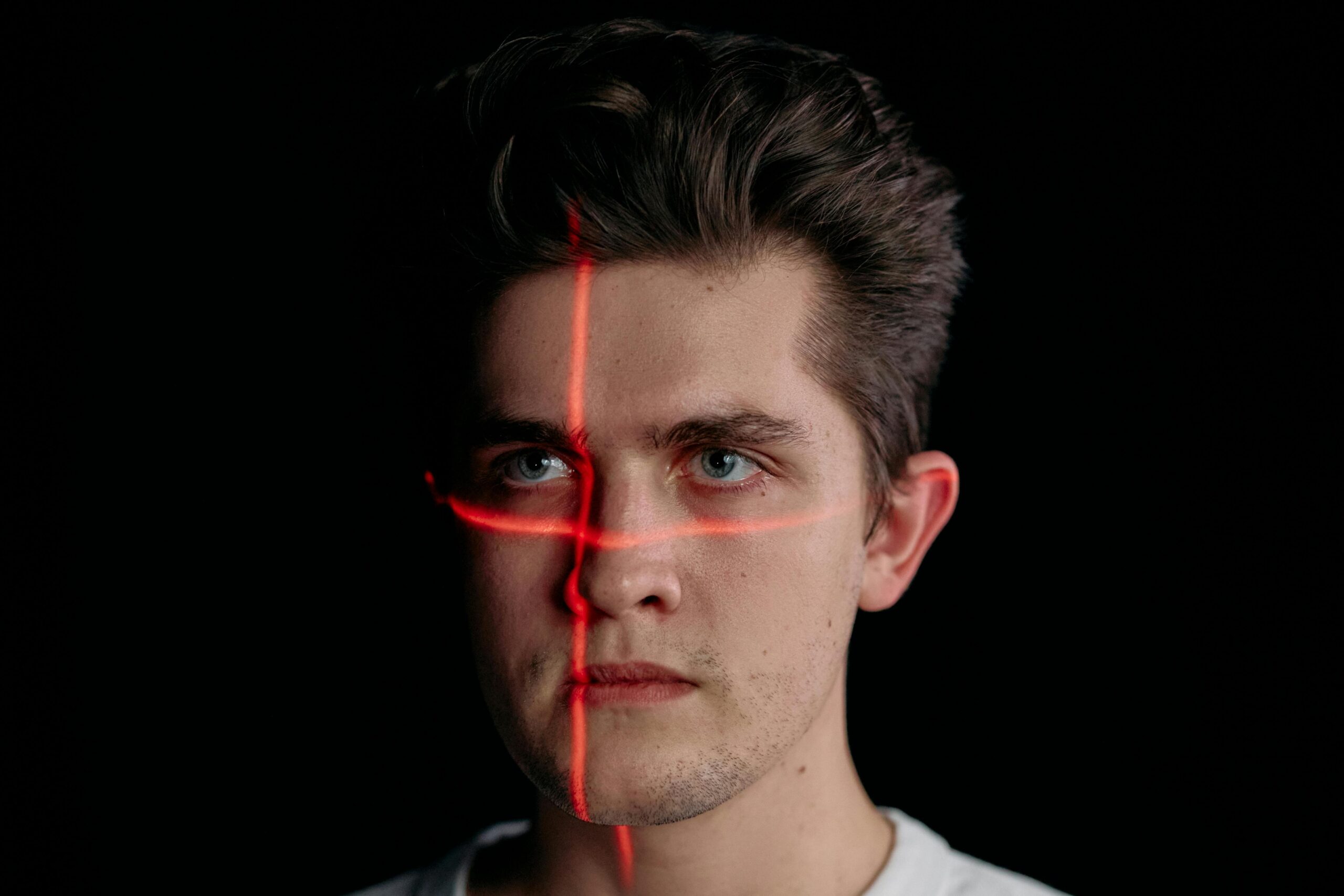

Korisnici Claude AI chatbota morat će potvrditi identitet sa ličnom ispravom i selfie fotografijom za određene funkcije

pexels-photo-8090294

pexels-photo-8090294

Korisnici Claude AI chatbota morat će potvrditi identitet sa ličnom ispravom i selfie fotografijom za određene funkcije

Anthropic, poznati AI startup, počeo je sa uvođenjem verifikacije identiteta za korisnike svog AI chatbota Claude u određenim slučajevima korištenja. Ova novost je najavljena 16. aprila 2026. godine, a kompanija navodi da će korisnici koji budu pristupali specifičnim mogućnostima Claude platforme biti upućeni na provjeru identiteta. Tačni slučajevi korištenja za koje će verifikacija biti potrebna nisu detaljno navedeni, a više informacija se očekuje naknadno.

Za verifikaciju korisnici će morati predočiti važeću fizičku ličnu ispravu sa fotografijom izdatom od strane državnog organa. Osim toga, od korisnika će se tražiti da naprave selfie koristeći kameru na telefonu ili računaru, kako bi sistem mogao uporediti fotografiju sa lične isprave sa trenutnim izgledom korisnika. Proces verifikacije identiteta biće realizovan u saradnji sa kompanijom Persona, koja je specijalizovana za digitalnu identifikaciju i već pruža usluge verifikacije starosne dobi za platforme kao što su OpenAI i Roblox.

Korisnici su, prema industrijskim izvorima, izrazili zabrinutost zbog potrebe za dodatnom verifikacijom, posebno ako su već registrovani kao pretplatnici i imaju podatke o plaćanju povezane sa svojim nalogom. Dodatno, pojedini su istakli zabrinutost zbog toga što je jedan od glavnih investitora kompanije Persona fond Founders Fund, koji je suosnovao Peter Thiel, poznat po angažmanu u nadzornim tehnologijama.

Anthropic je u svojoj objavi naglasio da će postupak verifikacije obavljati isključivo Persona, te da slike lične isprave i selfie fotografije neće biti kopirane niti trajno pohranjene. Kompanija ističe da je upotreba korisničkih podataka od strane Persone ograničena ugovorom, a svi podaci tokom procesa su enkriptovani, kako prilikom prijenosa tako i u stanju mirovanja. Anthropic dodatno navodi da se prikupljeni identifikacioni podaci neće koristiti za treniranje AI modela, niti će biti dijeljeni sa trećim stranama.

Ovaj potez Anthropic-a odražava rastuće zahtjeve za sigurnošću i regulacijom u AI industriji, posebno u kontekstu zaštite osjetljivih korisničkih podataka i odgovornog korištenja naprednih AI alata.